« Le succès de l’écoute sociale réside dans l’utilisation des bons outils pour la collecte de données. Sans données précises et fiables, vos insights sont erronés et vos décisions manquent leur cible. Commencez par des données de qualité, et le reste suivra. » – Vadim Savin, fondateur @notJust.dev

Bonjour à tous ! Je m’appelle Vadim et je suis ravi de partager avec vous ce tutoriel sur la façon dont j’ai créé une application de veille sociale alimentée par l’IA . Ce projet est conçu pour vous aider à surveiller votre marque, à obtenir des informations sur le marché et à garder une longueur d’avance sur la concurrence grâce aux outils Bright Data et aux technologies d’IA de pointe.

Avant de nous lancer, laissez-moi vous raconter rapidement l’histoire. Il y a quelques mois, je cherchais un outil pour surveiller ma marque sur Internet. Bien qu’il existe de nombreux outils spécialisés pour des plateformes spécifiques telles que Google ou les réseaux sociaux, je n’ai pas trouvé d’outil qui me donne une vue d’ensemble de la santé de ma marque sur le web. Je voulais savoir quand quelqu’un mentionnait mon travail, formulait une plainte ou quand mes concurrents lançaient une nouvelle initiative. Comme je ne trouvais pas l’outil idéal, j’ai décidé de le créer moi-même.

Aujourd’hui, je vais vous présenter l’ensemble du processus, de la collecte de données aux informations et à l’automatisation basées sur l’IA. Que vous soyez développeur, chef d’entreprise ou simplement curieux de découvrir le social listening, ce guide vous donnera des conseils pratiques pour mettre en œuvre ces fonctionnalités dans vos propres projets. C’est parti !

Pourquoi le social listening est-il important ?

Commençons par une question simple : à quelle fréquence vérifiez-vous ce qui se dit sur votre marque en ligne ? Si votre réponse est « pas souvent », vous passez probablement à côté d’informations précieuses provenant de vos clients et concurrents.

Le social listening consiste à surveiller les conversations en ligne afin de comprendre le sentiment des clients, les tendances émergentes et même les crises potentielles en matière de relations publiques avant qu’elles ne s’aggravent. C’est également un moyen efficace de garder une longueur d’avance sur vos concurrents en analysant leurs activités et leurs stratégies. Cependant, le défi réside dans la nature décentralisée de l’information, qui est dispersée sur les réseaux sociaux, les forums, les blogs et les moteurs de recherche.

C’est là que des outils tels que Bright Data et les grands modèles linguistiques (LLM) entrent en jeu. En combinant ces technologies, nous pouvons collecter des données sur l’ensemble du web, les traiter et en extraire des informations exploitables, le tout en un seul endroit.

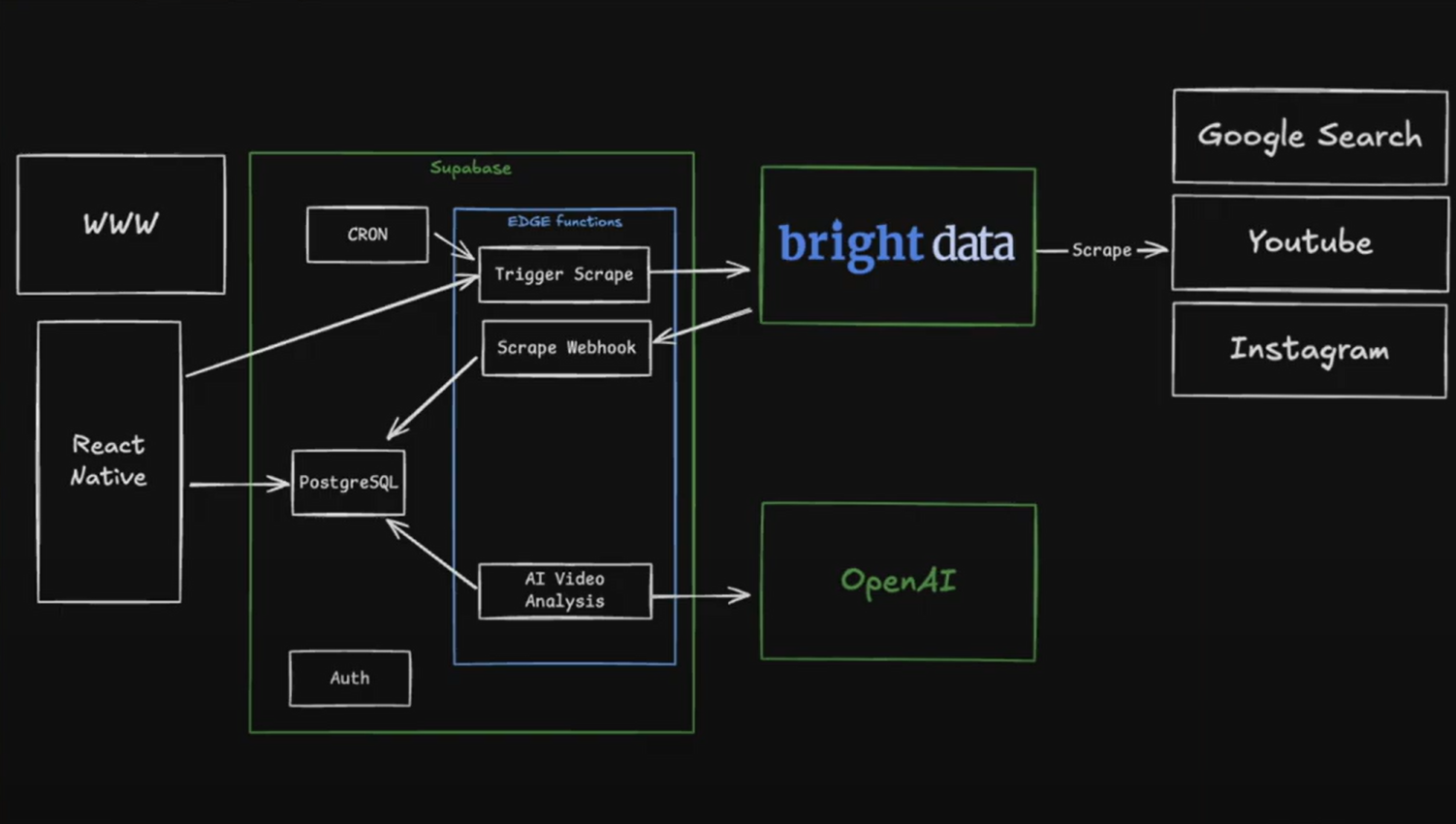

L’architecture d’une application de veille sociale

Voici un aperçu général du système que nous allons mettre en place :

- Collecte de données : utiliser les API de Bright Data pour extraire des données des moteurs de recherche, des plateformes de réseaux sociaux et d’autres sources.

- Stockage des données : stockez les données structurées dans une base de données pour faciliter leur accès et leur analyse.

- Informations basées sur l’IA : utilisez les grands modèles linguistiques d’OpenAI pour extraire des informations clés, telles que l’analyse des sentiments, les sujets tendance et les points faibles des clients.

- Automatisation : mettez en place un système pour surveiller et mettre à jour les données en continu, en mode automatique.

Décomposons cela étape par étape.

Étape 1 : Collecte de données avec les API Bright Data

Récupération des résultats des moteurs de recherche

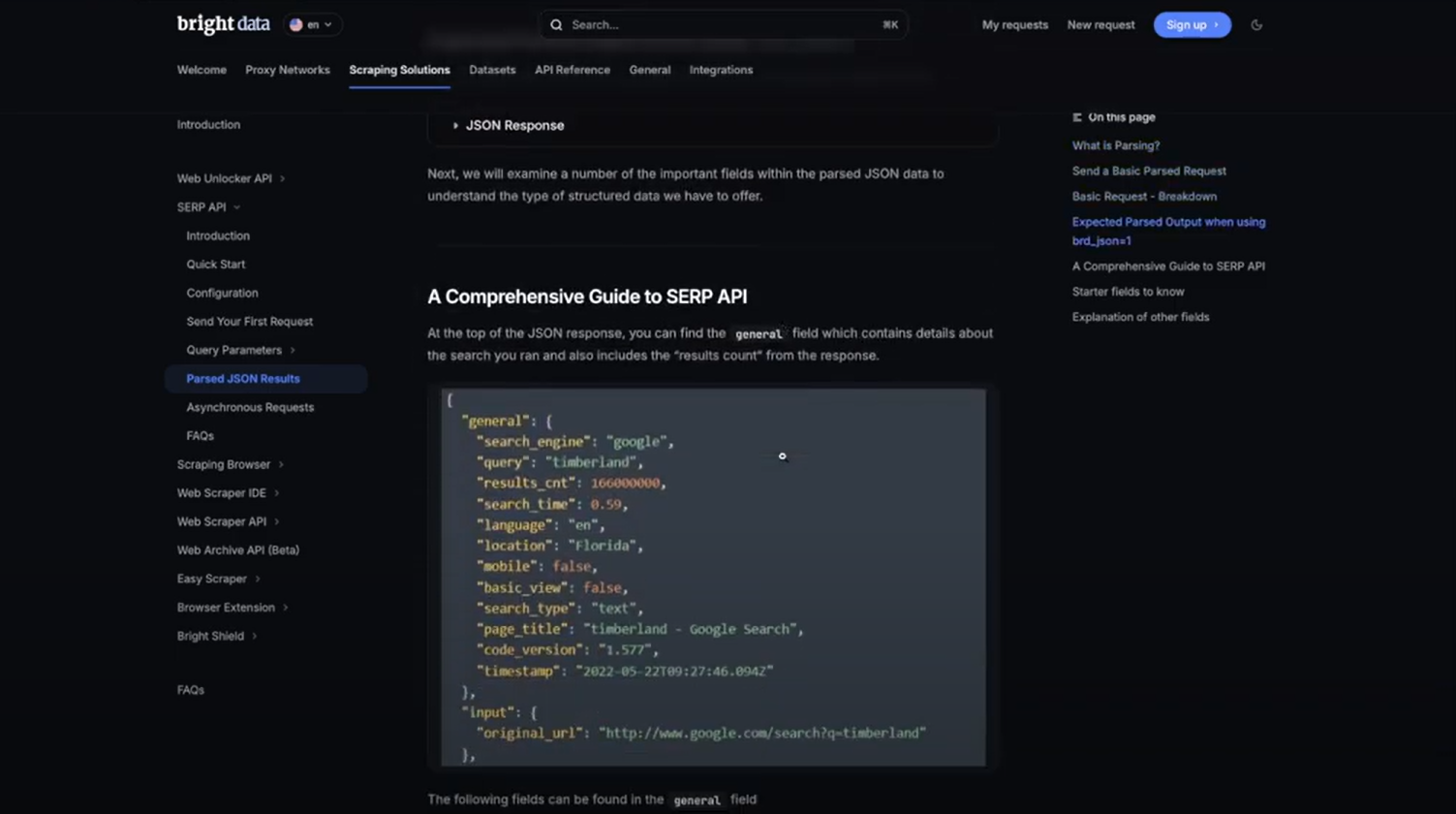

Pour surveiller les performances de votre marque sur les moteurs de recherche tels que Google, nous utiliserons l’API SERP de Bright Data . Cet outil facilite l’extraction des résultats des moteurs de recherche et permet d’extraire des données telles que les classements, les liens et les descriptions.

Voici comment cela fonctionne :

- Configurez une zone dans Bright Data avec la Résolution de CAPTCHA activée pour gérer les mesures anti-scraping.

- Utilisez l’API SERP pour envoyer une requête spécifique (par exemple, le nom de votre marque).

- Analysez la réponse JSON pour extraire les données dont vous avez besoin, telles que les liens organiques, les titres et les descriptions.

Une fois les données collectées, stockez-les dans une base de données telle que PostgreSQL ( hébergée sur Supabase ) pour un accès plus rapide et une analyse future.

Récupération de données sur les réseaux sociaux

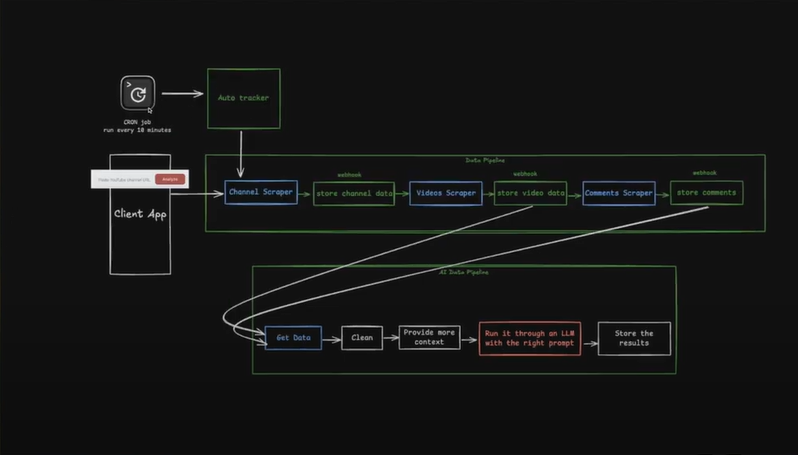

Les plateformes de réseaux sociaux sont des mines d’or pour les mentions de marques et les commentaires des clients. Les API Web Scraper de Bright Data fournissent des Scrapers pré-construits pour des plateformes telles que YouTube, Instagram, LinkedIn et Reddit.

Par exemple, pour extraire les données d’une chaîne YouTube :

- Utilisez le Scraper YouTube Profiles pour extraire des informations telles que le nombre d’abonnés, les liens vers les vidéos et les descriptions.

- Configurez un webhook pour recevoir automatiquement les données extraites une fois la tâche terminée.

- Stockez les données dans votre base de données pour un traitement ultérieur.

Le plus intéressant ? Les Scrapers de Bright Data sont régulièrement mis à jour et entretenus, vous n’avez donc pas à vous soucier des modifications apportées au site web qui pourraient perturber votre code.

Étape 2 : Analyse des données avec l’IA

Une fois les données collectées, l’étape suivante consiste à extraire des informations exploitables à l’aide de l’IA. C’est là qu’interviennent les grands modèles linguistiques (LLM) d’OpenAI.

Cas d’utilisation n° 1 : analyse de transcriptions vidéo

Pour les vidéos YouTube, nous pouvons analyser les transcriptions afin de :

- Résumer le contenu.

- Extraire les principaux sujets de discussion.

- Identifier les mentions de marques et les horodatages.

À l’aide de l’API d’OpenAI, nous envoyons la transcription accompagnée d’une invite précisant le format de sortie souhaité (par exemple, JSON). L’IA renvoie ensuite un résumé structuré et les sujets clés, que nous stockons dans la base de données.

Cas d’utilisation n° 2 : analyse des sentiments exprimés dans les commentaires

Les commentaires des clients sont précieux pour comprendre l’opinion publique. En analysant les commentaires YouTube (ou les publications d’autres plateformes), nous pouvons :

- Déterminer le sentiment ( positif, négatif ou neutre).

- Extraire les sujets communs et les points sensibles.

- Identifier les tendances ou les crises potentielles en matière de relations publiques.

Le processus consiste à :

- Envoi d’un lot de commentaires à l’API d’OpenAI avec une demande d’analyse du sentiment et d’extraction des thèmes.

- L’analyse de la réponse JSON et le stockage des résultats dans la base de données.

- L’affichage des informations dans un tableau de bord convivial.

Étape 3 : Automatisation du flux de travail

Pour rendre le système vraiment puissant, nous devons automatiser l’ensemble du processus. Cela implique de configurer une tâche cron pour , de manière périodique :

- Déclencher le scraping des données pour les éléments suivis (par exemple, des canaux spécifiques, des requêtes de recherche ou des profils de réseaux sociaux).

- Exécuter une analyse IA sur les données nouvellement collectées.

- Mettre à jour la base de données et informer les utilisateurs des changements importants.

Par exemple, vous pouvez programmer le système pour qu’il extraie les résultats de recherche Google toutes les 24 heures ou surveille les publications Reddit toutes les 10 minutes. Cela vous garantit de toujours disposer d’informations à jour sans intervention manuelle.

Étape 4 : Création de l’interface utilisateur

Au niveau du front-end, vous pouvez créer un tableau de bord où les utilisateurs peuvent :

- Suivre des canaux, des requêtes de recherche ou des profils spécifiques.

- Consulter des informations en temps réel, telles que l’analyse des sentiments et les sujets tendance.

- Recevoir des alertes en cas de changements importants ou de crises potentielles en matière de relations publiques.

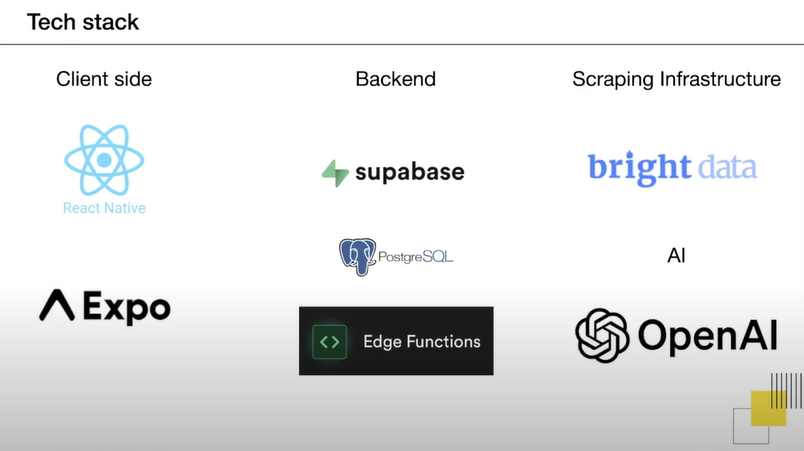

À l’aide d’outils tels que React Native et Expo , vous pouvez créer une application multiplateforme qui fonctionne de manière transparente sur le Web et les appareils mobiles.

Et ensuite ? Améliorer votre application de veille sociale

Voici quelques idées pour faire passer votre application au niveau supérieur :

- Alertes et notifications : configurez des alertes par e-mail ou Slack pour des indicateurs ou des seuils spécifiques.

- Analyse de la concurrence : comparez les performances et le sentiment de votre marque avec ceux de vos concurrents.

- Données historiques : suivez les changements au fil du temps pour identifier les tendances et les progrès.

- Recommandations IA : utilisez l’IA pour suggérer des mesures concrètes basées sur les informations recueillies.

- Systèmes RAG : mettez en œuvre la génération augmentée par la récupération (Retrieval-Augmented Generation) pour créer un chatbot ou un moteur de recherche pour vos données.

Conclusion

En combinant les outils de scraping de Bright Data avec les grands modèles linguistiques d’OpenAI, nous avons créé une application de veille sociale évolutive et alimentée par l’IA qui peut surveiller votre marque sur Internet. De la collecte de données à l’extraction d’informations et à l’automatisation des flux de travail, ce système vous permet de rester informé et de prendre des décisions basées sur les données.

J’espère que vous avez trouvé ce guide utile et inspirant. Si vous avez des questions ou souhaitez partager vos propres cas d’utilisation, n’hésitez pas à me contacter sur les réseaux sociaux ou à consulter ma chaîne YouTube pour plus de tutoriels.

Un grand merci à Bright Data pour avoir fourni les outils qui ont rendu ce projet possible.